Vaše lokální AI už nemusí být izolovaným ostrovem bez přístupu k aktuálním informacím. Díky spojení LM Studia, protokolu MCP (Model Context Protocol) a Dockeru můžete svůj model proměnit v autonomního agenta, který vyhledává na Googlu, čte z GitHubu nebo analyzuje data v reálném čase.

Tohle řeší největší slabinu lokálních LLM: neschopnost vidět za hranice svých trénovacích dat.

Klíčové pilíře integrace

- MCP (Model Context Protocol): Unifikované rozhraní, které slouží jako „univerzální modul“ pro připojení AI k jakémukoli nástroji.

- Docker MCP Toolkit: Bezpečnostní vrstva Docker MCP, která separuje oprávnění AI agentů od citlivých dat v operačním systému.

- LM Studio: Hostitelská aplikace, která umožňuje modelům volat externí funkce (Tools).

- Katalog nástrojů: Okamžitý přístup k více než 200 nástrojům (DuckDuckGo, Brave Search, GitHub, Slack, Notion,..).

Proč lokální AI dává smysl?

Dlouhou dobu byla největší překážkou lokálního provozu AI tzv. informační slepota. Jakmile model opustil trénovací fázi, nevěděl nic o dnešních zprávách nebo stavu vašich projektů. Ruční kopírování textů do promptu je neefektivní a rychle vyčerpá kontextové okno modelu.

Tento most mezi modelem a webem však vyžaduje pevnou konstrukci. Právě zde přichází na řadu standardizace. MCP funguje jako překladač: model řekne „potřebuji vědět, jaké je počasí v Praze“ a MCP server (např. duckduckgo Search) mu dodá přesná data ve formátu, kterému model rozumí.

Bezpečnost na prvním místě: Proč chtít Docker?

Možná vás napadne, proč prostě nespustit MCP server přímo v systému. Odpověď je jednoduchá: izolace. Spuštění neprověřeného kódu, který má přístup k internetu i k vašemu LLM, je bezpečnostní noční můra. Docker MCP Toolkit balí tyto servery do kontejnerů s omezenými privilegii.

Technické nastavení a hardwarové nároky

Pro úspěšné zprovoznění potřebujete model, který zvládá tzv. Tool Calling. Starší modely neumí správně vygenerovat příkaz pro volání externí funkce. Doporučujeme modely jako Llama 3.1 Instruct, Qwen 3 nebo Gemma 3, které jsou na MCP přímo optimalizovány.

📋 Rychlý přehled: Co budete potřebovat

Než začnete, ujistěte se, že váš hardware splňuje parametry pro plynulý běh kontejnerů i samotného modelu.

| Komponenta | Minimální požadavek | Doporučený zdroj |

| LM Studio | Verze 0.3.17 nebo novější | lmstudio.ai |

| Docker Desktop | Aktuální verze s MCP Toolkit | docker.com |

| LLM Model | Např. Llama 3.1+ nebo Qwen 2.5+ (Instruct) | Aplikace LM Studio |

Krok 1: Instalace

Prvním krokem je LM Studio, stáhněte si LM Studio a nainstalujte.

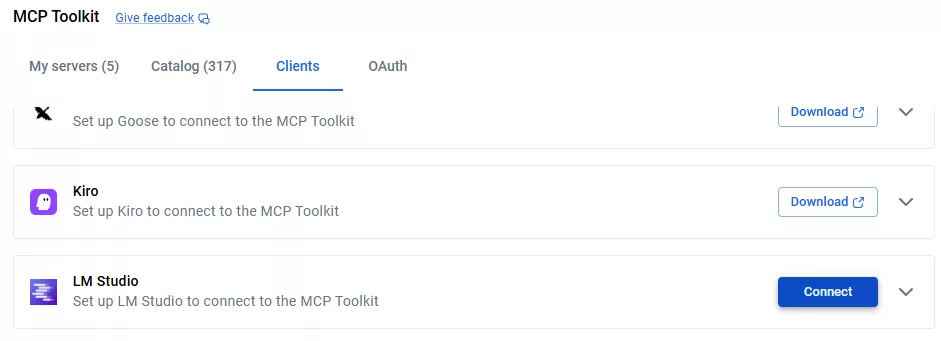

Druhým krokem je instalace Docker Desktopu. Po instalaci přejděte do sekce MCP Toolkit. Zde vyberte LM Studio a klikněte na „Connect“. Po nastavení bude potřeba restartovat klienta.

⚡Jde vám AI pomalu?

RTX 5060 Ti (16GB)

Ideální vstupní brána do světa lokálních AI.

- VRAM: 16 GB GDDR7

- AI akcelerátor: 5. generace

- Výhoda: Solidní poměr cena/výkon

Laptop RTX 5080

Pracovní stanice pro vývojáře. 16GB VRAM dovoluje spouštět těžší modely lokálně i při multitaskingu.

- VRAM: 16 GB GDDR7

- RAM: 32 GB

- Procesor: Intel Core 7 240H

MacBook Pro M4 Max

Specialista na velké AI modely. Díky unifikované paměti až 128 GB zvládne projekty, na kterých běžné notebooky často končí kvůli nedostatku paměti.

- RAM: 36 – 128 GB

- Čip: Apple M4 Max

- Výdrž: Až 24 hodin

Přečtěte si více o doporučeném HW pro lokální AI modely.

Krok 2: Aktivace MCP serveru v Dockeru

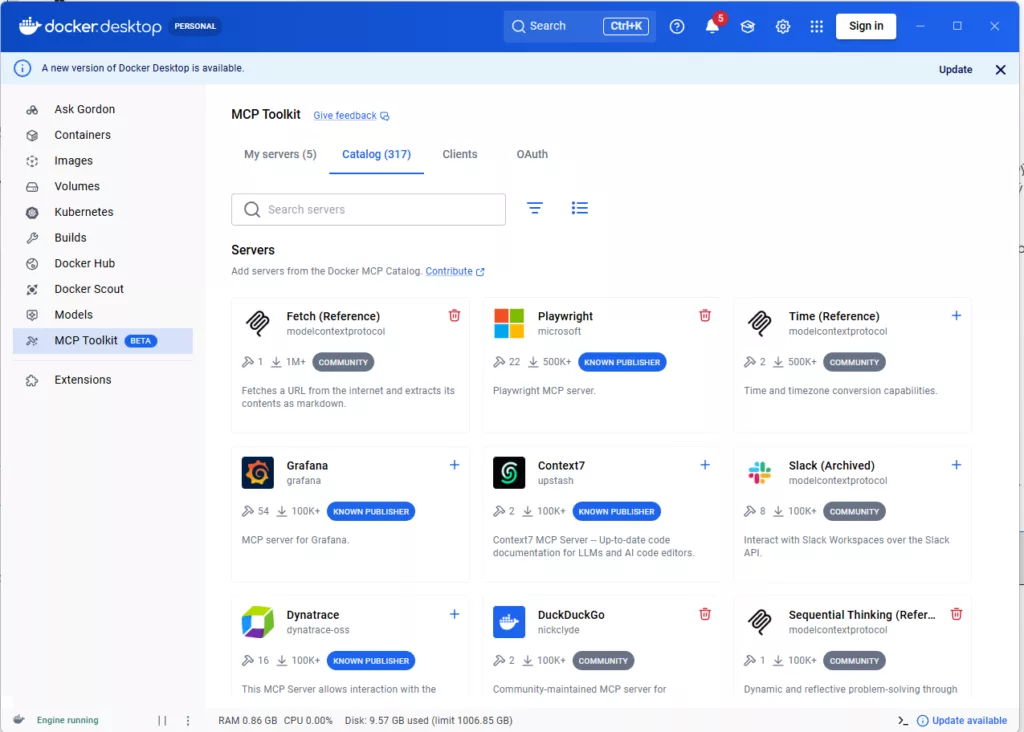

Otevřete Docker MCP Toolkit. V záložce Catalog uvidíte více než 300 různých serverů. Pro přístup k internetu zvolte například DuckDuckGo nebo Brave Search (ten ovšem bude vyžadovat váš API klíč).

Klikněte na tlačítko „Add MCP server“. Docker automaticky stáhne obraz kontejneru a připraví izolované prostředí. V tuto chvíli máte funkční „překladač“, který čeká, až ho někdo osloví.

Krok 3: Propojení s LM Studiem

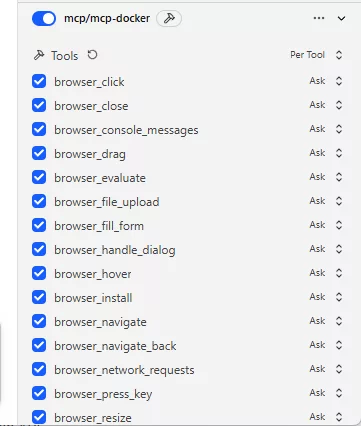

Nyní se přesuňte do LM Studia a na pravé straně zapněte „mcp/mcp-docker“ .Tím aktivujete možnost využití „Tools“, kterou ovšem můžete kdykoliv vypnout.

Krok 4: První dotaz do „živého“ internetu

To nás přivádí k výběru správného modelu. V LM Studiu vyhledejte model, který podporuje „Tools“. Bez této schopnosti model sice uvidí tlačítka internetu, ale nebude vědět, jak je stisknout.

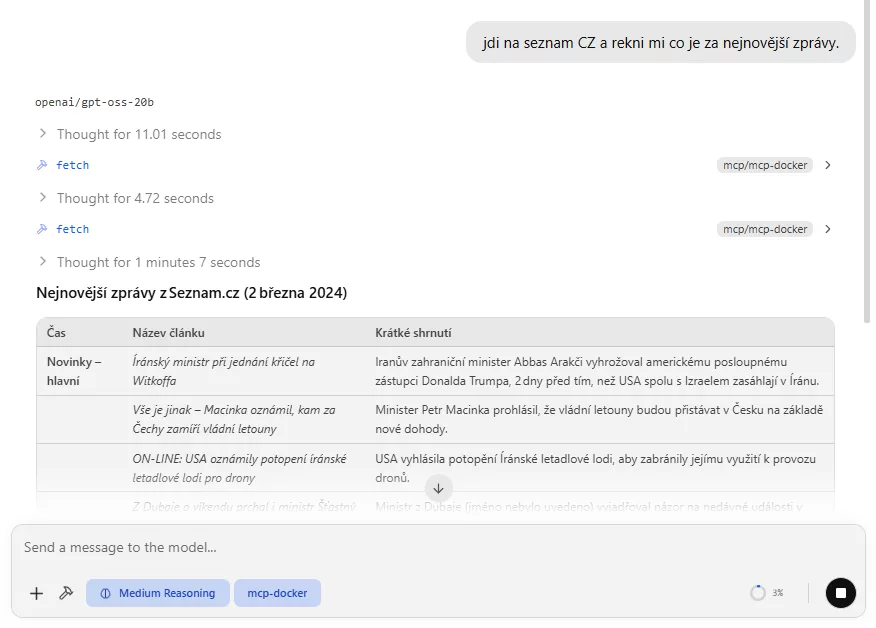

Zkuste jednoduchý dotaz: „jdi na seznam.cz a rekni mi co je za nejnovější zprávy.“ Uvidíte, jak model vyvolá nástroj, Docker provede vyhledávání a vrátí modelu fakta ve formátu , kterému rozumí.

Nezapomeňte, že pro správné fungování je potřeba mít vždy spuštěný jak Docker Desktop, tak LM Studio.