Představte si, že máte ve svém počítači mozek, který se vyrovná chatGPT, ale nikdo nevidí vaše data, neplatíte měsíční poplatky a funguje to i bez internetu. To není sci-fi, to je realita lokálních LLM (Large Language Models) v roce 2026. Zatímco cloudové giganty jako OpenAI drží klíče od království, nástroje jako LM Studio tuto sílu demokratizují a vkládají ji přímo do vašeho hardwaru.

Pokud chcete vědět, jak rozjet AI na vlastním „železe“, jste na správném místě.

Klíčová zjištění

- Soukromí na prvním místě: Lokální AI zajistí, že citlivá data nikdy neopustí váš stroj.

- LM Studio je jako „WhatsApp“: stejně jako si ve WhatsAppu vyberete, komu napíšete zprávu, v LM Studiu si vyberete, s kterým modelem si budete psát. Vše probíhá v přehledném chatovém okně, takže není potřeba žádné složité kódování.

- Hardware je král: Pro smysluplnou práci potřebujete alespoň 16 GB RAM a nejlépe dedikovanou GPU (např. RTX 3060 a vyšší).

- Větší je lepší: Je výhodnější spustit velký model (34B) v nižší kvalitě (kvantizaci) než malý model v plné kvalitě.

1. Revoluce v rozhraní: LM Studio vs. Ollama

Zatímco Ollama dominuje jako nástroj pro příkazovou řádku (CLI) a je miláčkem vývojářů, LM Studio je šampionem s grafickým rozhraním (GUI). Nabízí „user-friendly“ instalaci, která připomíná běžné desktopové aplikace, a eliminuje nutnost zápasit s Dockerem nebo programováním.

Porovnání klíčových hráčů

| Funkce | LM Studio | Ollama |

| Typ rozhraní | GUI (Grafické) | CLI (Příkazová řádka) |

| Cílová skupina | Byznys uživatelé, začátečníci | Vývojáři, DevOps |

| Latence (1. token) | Variabilní | Rychlejší |

| Objevování modelů | Integrované (napojení na Hugging Face) | Manuální (přes web library) |

To nás přivádí k otázce výkonu, protože ani ten nejhezčí software nezachrání špatný hardware.

2. Hardwarová realita a magie kvantizace

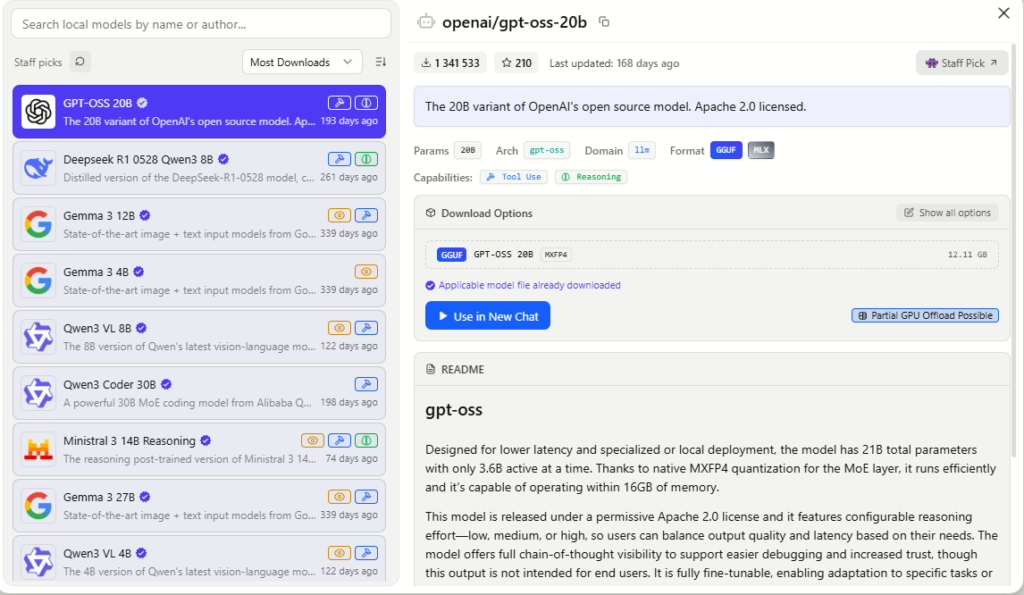

Jedním z největších úskalí uživatelů je „hardwarová zmatenost“. Lidé často netuší, co jejich stroj zvládne. LM Studio tento problém řeší elegantně: automaticky zobrazuje doporučené modely podle paměti vašeho zařízení.

VRAM (video paměť grafické karty) je totiž kritickým faktorem úspěchu. Pokud se model nevejde do VRAM, musí využívat pomalejší systémovou RAM a CPU, což drasticky snižuje rychlost.

Jaké železo skutečně potřebujete?

Podle dat z roku 2026 vypadá doporučená konfigurace následovně:

- Minimum: 8 GB RAM (pro modely <4B) a 6 GB VRAM. Očekávejte rychlost 1–2 tokeny za sekundu (T/s).

- Doporučeno: 16 GB+ RAM a dedikovaná GPU s 12 GB+ VRAM (např. RTX 3060).

- High-end: Apple M4 Max (64 GB RAM) nebo RTX 5090 (32 GB GDDR7 VRAM). Zde dosáhnete rychlosti 15–20+ T/s i u velkých 13B modelů.

⚡Rychlý výběr

RTX 5070 (12GB)

Ideální pro bastlíře a upgrade stávajícího PC. GDDR7 paměti zajistí bleskovou odezvu u modelů jako Llama 3.

- VRAM: 12 GB GDDR7

- Technologie: NVIDIA Blackwell

- Výhoda: až 30x rychlejší trénování AI

Laptop RTX 5080

Pracovní stanice pro vývojáře. 16GB VRAM dovoluje spouštět těžší modely lokálně i při multitaskingu.

- VRAM: 16 GB GDDR7

- RAM: 32 GB

- Procesor: Intel Core 7 240H

MacBook Pro M4 Max

Specialista na velké AI modely. Díky unifikované paměti až 128 GB zvládne projekty, na kterých běžné notebooky často končí kvůli nedostatku paměti.

- RAM: 36 – 128 GB

- Čip: Apple M4 Max

- Výdrž: Až 24 hodin

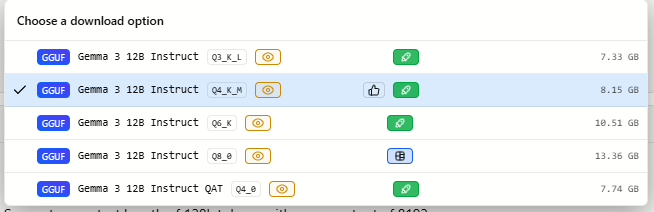

Kvantizace: Umění komprese

Možná si říkáte, jak nacpat obří model do malého notebooku. Odpovědí je kvantizace. Představte si to jako kompresi fotek do formátu JPEG. Ztratíte trochu vizuální kvality (v případě AI přesnosti), ale získáte obrovské množství místa.

Praktický dopad je ohromující:

- Plná přesnost (FP16) modelu o velikosti 16 GB se po 4-bitové kvantizaci (Q4) smrskne na cca 5 GB při minimální ztrátě kvality.

- 34B model v kvantizaci Q3 zabírá 17 GB, zatímco v plné velikosti by vyžadoval 68 GB.

Platí zde zlaté pravidlo „Moudrosti modelu“: Je lepší spustit větší model s nižší kvantizací (např. 34B Q3) než malý model s vysokou přesností (13B Q8). Větší modely mají jednoduše lepší logiku a uvažování.

3. Pokročilé funkce pro profesionály

LM Studio není jen o chatování. Pod kapotou, se skrývají nástroje, které mění pravidla hry pro vývojáře i analytiky.

Lokální API Server

LM Studio dokáže na localhostu emulovat OpenAI API (v1/chat/completions). To znamená, že můžete vzít jakýkoliv nástroj navržený pro ChatGPT a jednoduše ho přesměrovat na váš lokální model. Získáte tak chytrého asistenta pro kódování zcela offline a zdarma.

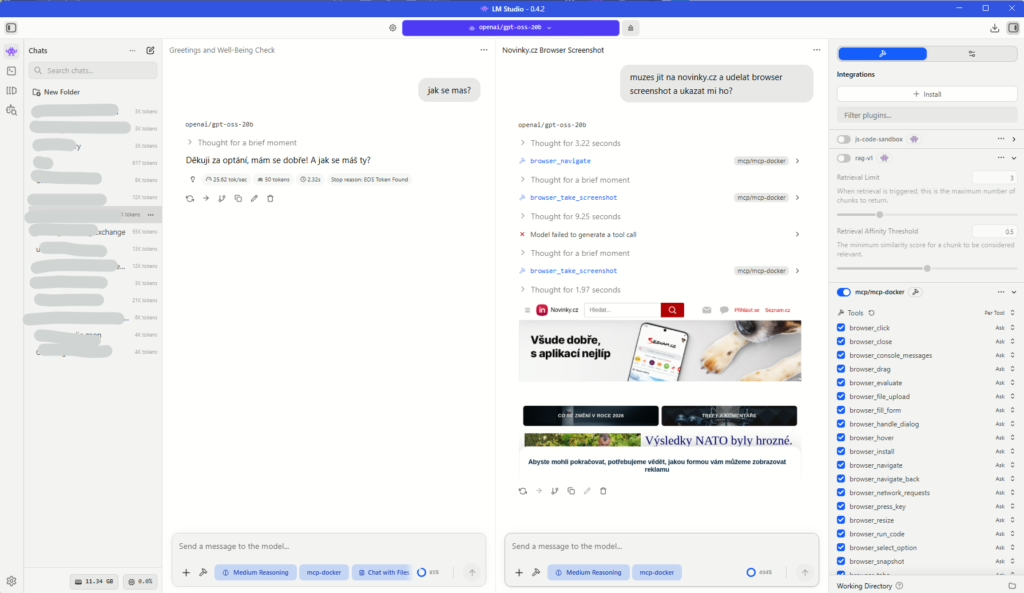

Model Context Protocol (MCP)

Novinkou je podpora MCP serverů. To umožňuje lokálním agentům používat externí nástroje, jako je JavaScript sandbox nebo vyhledávání přes Brave, čímž se překonává limit „uzavřenosti“ lokálních modelů.

4. Bezpečnost a řešení problémů

V éře cloudu je soukromí luxus. U služeb jako ChatGPT nebo Claude vždy existuje riziko využití vašich dat pro trénování. Lokální běh AI zajišťuje, že data nikdy neopustí váš stroj, což je naprosto klíčové pro sektory jako zdravotnictví nebo finance. Navíc, pro výzkumníky v terénu funguje LM Studio zcela bez závislosti na internetu.

Co dělat, když AI „zapomíná“?

Častou stížností je, že AI ztrácí nit konverzace (protože modely jsou ze své podstaty stateless). Řešením v LM Studiu je manuální nastavení parametru Context Length. Pokud máte dostatek RAM, můžete tento limit zvýšit z běžných 2048 na 4096 a více tokenů, čímž modelu rozšíříte „krátkodobou paměť“.

Stejně tak, pokud se potýkáte se stagnací výkonu, klíčem je parametr n-gpu-layers. Ten určuje, kolik vrstev modelu se přesune do VRAM. Pokud tuto hodnotu nastavíte vyšší, než je počet vrstev modelu, celý model se načte do grafické karty a vy získáte maximální rychlost.

Expertní doporučení: Pokud začínáte, stáhněte si LM Studio a vyhledejte model „Mistral 7B“ nebo „Llama 3“ ve formátu GGUF s kvantizací Q4_K_M. Je to ideální rovnováha mezi rychlostí a inteligencí pro většinu moderních PC.

Jak začít s LM Studiem ve 3 krocích:

- Stáhněte si aplikaci pro svůj systém na oficiálním webu lmstudio.ai.

- V integrovaném vyhledávání najděte model (např. Llama 3 nebo Mistral).

- Klikněte na Download, počkejte na stažení a v sekci AI Chat vyberte model a můžete začít psát.

5. Často kladené dotazy (FAQ)

Mám starý počítač. Má smysl zkoušet lokální AI?

Ano. I na starším stroji lze spustit menší modely (např. Phi-2 nebo 7B verze) v silné kompresi/kvantizaci. Odezva bude v řádu minut, nikoliv sekund, ale bude funkční.

Je LM Studio open-source?

Není. Aplikace jako taková je proprietární (uzavřená), ale pro osobní užití je zdarma. Je postavena na open-source jádru llama.cpp. Pokud striktně vyžadujete open-source řešení, zvolte Ollamu.

Jak nainstaluji modely z Hugging Face?

V LM Studiu je to hračka. Přímo při vyhledávání modelu naleznete v dolní části i Hugging Face modely.

Proč je můj model pomalejší než ChatGPT?

Cloudové modely běží na serverových farmách s desítkami GPU (H100). Váš domácí počítač má limity. Pro zrychlení se ujistěte, že využíváte „GPU Offloading“ a nemáte spuštěné jiné náročné aplikace, které „žerou“ VRAM.